Planbar statt Glückssache

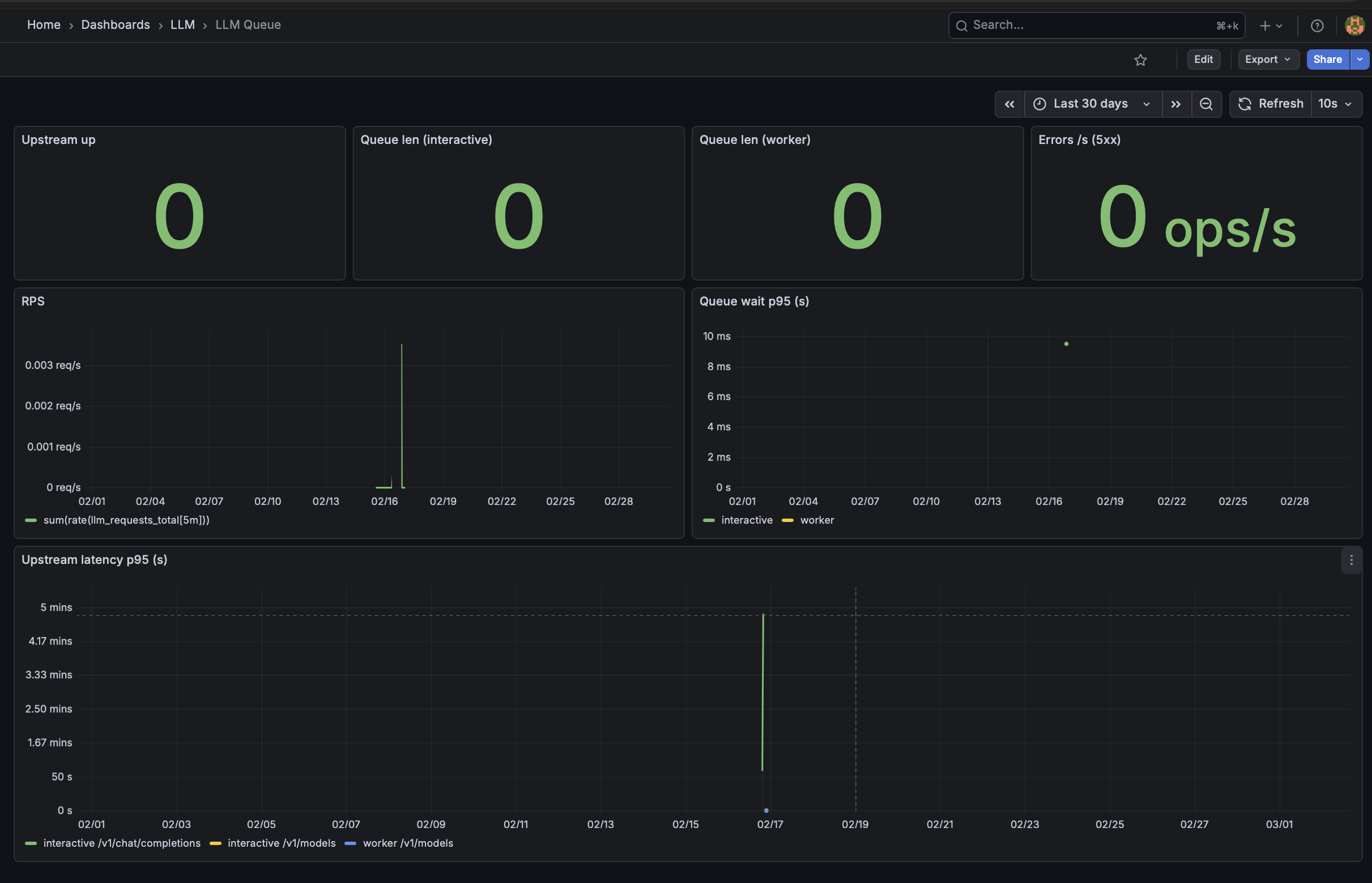

KI soll auch dann funktionieren, wenn es stressig wird: Last, Updates, Rate‑Limits, Ausfälle.

Wir bringen KI in den Betrieb, sodass sie verlässlich hilft – nicht nur in Demos.

Fokus: on‑prem‑first (so weit wie möglich lokal), mit klaren Regeln für Sicherheit, Kosten und Qualität.

KI soll auch dann funktionieren, wenn es stressig wird: Last, Updates, Rate‑Limits, Ausfälle.

Wir verhindern, dass Agenten „im Kreis laufen“ und die Rechnung explodiert.

Wir machen Ziele testbar, damit KI nicht nur schnell, sondern richtig liefert.

Standard‑Workflows lokal. Cloud nur für seltene Heavy‑Cases.

Limits, Budgets und Messpunkte – damit Betrieb skalierbar bleibt.

Wenn ein Anbieter limitiert oder teurer wird, läuft es trotzdem weiter.

Agenten ohne Kontrollverlust: minimale Rechte, geprüfte Tools, Audit‑Trail, Kill‑Switch.

KI als „Wachhund“ gegen schleichende Verschlechterung (Performance‑Rot, Cache‑Probleme, Hidden Costs).

Kurzübersetzung, falls du tiefer rein willst: